Forklarlig AI handler ikke kun om ansvarlighed – det kan også give bedre modeller

27.4.2021 07:00:00 CEST | Alexandra Instituttet | Pressemeddelelse

Folk støder ind i ting og hinanden i deres biler. Temmelig ofte. Det går heldigvis sjældent rigtig galt, men galt nok til at forsikringsselskaber modtager mange skadesanmeldelser på buler og skrammer på vores biler. Alle de skadeanmeldelser skal vurderes, og det siger sig selv, at hvis man kan få en computer til at klare de simple sager, så kan det frigive ressourcer og give kunderne hurtigere svar.

Helt simpelt er det dog ikke at få en computer til at genkende skader på biler.

”En computer forstår jo ikke, hvad en skramme eller en bule er. Den kan sammenligne billeder og ud fra det gætte på, om et nyt billede har en lignende fordeling af pixels, som tidligere billeder den har set af skrammer og buler. Men hvis ikke man har trænet computeren godt nok, så kan skyggen fra personen, der tager billedet af bilen, forskellen på solskin og regnvejr eller noget helt tredje spille ind på, om computeren kan træffe en korrekt afgørelse eller ej” forklarer Katrine Hommelhoff Jensen, Senior Computer Vision and Graphics Specialist og Ph.D. ved Alexandra Instituttet og fortsætter:

”Skadesbillederne, som Topdanmark modtager, kan indeholde alle former for biler og dertil vekslende belysning, zoom, vinkel og baggrund - der er med andre ord meget variation i data. Så en stor udfordring er, at man skal have meget data for at kunne træne en model godt nok til at kunne vurdere, hvad der er en skramme eller bule, og hvad der for eksempel bare er snavs, designdetaljer og refleksion”.

Men ikke engang nok data kan være tilstrækkeligt for at træne en præcis model.

For at se dette indhold fra cdn-images-1.medium.com, så skal du give din accept på toppen af denne side.

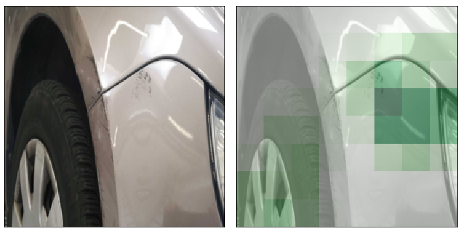

XAI-værktøjer kan bl.a. anvendes til at visualisere hvilke områder i et billede, der har haft størst betydning for en models klassifikation af billedet. Her er et eksempel på en sådan visualisering for en model, der har klassificeret billedet af en bil-del som værende 'skadet' (vs 'ikke-skadet'). Selvom klassifikationen er korrekt, så kan det som her vise sig, at modellen inddrager meget andet og måske irrelevant information - udover skrammen midt på billedet, bliver bildæk og refleksioner også forbundet med klassifikationen. Denne viden kan hjælpe til at målrette indsatsen for en bedre model med større generaliseringsevne.

Når vi taler om forklarlig kunstig intelligens (eng. Explainable AI, eller bare XAI), taler vi ofte om det i en kontekst, hvor det her fx vil betyde, at hvis en kunde ikke forstår det svar, som hun får på sin skadeanmeldelse, så har man indlagt et værktøj i sin kunstige intelligens, som kan vise, hvorfor computeren har svaret, som den har. Men den gennemsigtighed kan bruges allerede i udviklingen af modellen.

Hvis computeren eksempelvis fejlagtig tror, at en bestemt slags skygge er en bule, så vil man kunne få vurderet sin model til at være meget præcis, fordi den finder alle skyggerne. Det var bare ikke skyggerne, den skulle finde, men bulerne. Men det finder man først ud af, når man er gået i gang med at bruge modellen, fordi den jo fik en høj præcision-score i træningen.

Men hvis man benytter et forklaringsværktøj, så vil man kunne se hvor på billedet computeren har fokuseret for at nå frem til sit resultat. Derfor vil man hurtigere kunne spotte, hvis computeren faktisk fokuserer på en skygge frem for en bule.

Hos Topdanmark har de allerede høstet nogle af frugterne med forklarlig AI. Med rådgivning fra Alexandra Instituttet i ryggen har de fået en dybere indsigt i, hvordan man analyserer computerens klassifikationer, og er blevet introduceret til XAI-værktøjer, der kan visualisere beslutningerne truffet i en klassifikationsmodel.

”Det har været en stor hjælp at kunne lave et visuelt tjek på vores modeller – selvom de umiddelbart er statistisk stærke, kan vi nu se, om de rent faktisk fokuserer på det, vi har brug for, at de fokuserer på. Og gør de ikke det, så kan vi nu optimere det mere effektivt, ved udelukkende at skærpe de afgørende elementer. Samarbejdet med Alexandra Instituttet har været et af de mest øjenåbnende samarbejder, vi nogensinde har haft. Vi har ikke selv mulighed for at forske, men området rykker sig hurtigt, så det har været fantastisk at kunne få eksperterne fra Alexandra til at komme og se på en specifik udfordring og hjælpe os med at løse den", forklarer Stig Geer Pedersen, seniorprojektleder Machine Learning i Topdanmark, og fortsætter:

"Vi har ikke bare haft en teoretisk diskussion, men kigget nært på problemet. Også vores fagligt dygtige data scientists, der virkelig skal kunne se formålet med et sparringsforløb, har haft glæde af samarbejdet, fordi de har fået et hjælpeværktøj til videre analyse inden for et felt, som vi nu ser som en naturlig del af vores forretning”, runder Stig Geer Pedersen af om samarbejdet med Katrine og hendes team ved Alexandra Instituttet.

I mange virksomheder har man i dag kompetencer inden for machine learning i eget hus, men ofte kan et lag af rådgivning omkring nye metoder inden for bl.a. forklarlig AI, ligesom her ved Topdanmark, give et skub i retning af en bedre forståelse for, hvordan ens modeller performer - og ikke mindst, hvordan man kan forbedre dem.

Tag fat i os, hvis du vil høre, om det er noget, du kan få glæde af.

Nøgleord

Billeder

Information om Alexandra Instituttet

Alexandra Instituttet

Alexandra InstituttetÅbogade 34 · Rued Langgaards Vej 7

8200 Aarhus N · 2300 København S

+45 70 27 70 12https://alexandra.dk

100 eksperter under ét tag

Alexandra Instituttet hjælper offentlige og private virksomheder med at anvende den nyeste it-forskning og -teknologi. Vores udgangspunkt er samfundsmæssige problemstillinger og behov for at omsætte den nyeste forskning til innovative løsninger.

Hos os finder du stærke kompetencer inden for blandt andet visual computing, kunstig intelligens, IoT, cybersikkerhed, interaktionsdesign og smarte produkter.

Vi arbejder i et tværfagligt miljø og er et hold af højtkvalificerede specialister, der hurtigt kan forstå din organisations og dine brugeres problemstillinger.

Følg pressemeddelelser fra Alexandra Instituttet

Skriv dig op her, og modtag pressemeddelelser på e-mail. Indtast din e-mail, klik på abonner, og følg instruktionerne i den udsendte e-mail.

Flere pressemeddelelser fra Alexandra Instituttet

Forskningen rykker ud til SMV’erne: Fire nye projekter skal styrke digital sikkerhed i Danmark21.5.2026 11:15:16 CEST | Pressemeddelelse

Fire nye cybersikkerhedsprojekter får nu støtte fra innovationspartnerskabet Next Generation Cyber Security. Projekterne skal omsætte avanceret digital forskning til løsninger, som danske virksomheder kan bruge til at øge sikkerheden.

Alexandra Instituttet bringer glemt erhvervskvinde tilbage til Holstebros byrum med 3D-teknologi8.3.2026 06:15:00 CET | Pressemeddelelse

Ved hjælp af avanceret 3D-print har Alexandra Instituttet skabt en buste af erhvervskvinden Karoline Poulsen fra Holstebro – 60 år efter hendes død. Busten viser, hvor langt teknologien er kommet, og lægger kimen til bedre repræsentation af kvinder i det offentlige rum.

Gratis videreuddannelse til rådgivere skal gøre industrien cyber-robust19.2.2026 13:25:07 CET | Pressemeddelelse

Efter fire års intenst arbejde med at øge danske virksomheders cybersikkerhed er CyPro-samarbejdet nu nået til en vigtig milepæl. Det betyder, at værktøjerne kan tages i brug af rådgivere helt gratis.

Cybersikkerhedsbranchen går sammen om at løfte små- og mellemstore virksomheder i ny millionsatsning fra Industriens Fond30.1.2026 09:11:29 CET | Pressemeddelelse

23 virksomheder i den danske cybersikkerhedsbranche har valgt at donere ydelser svarende til 33,5 millioner kroner til en ny national satsning, der skal øge sikkerheden i små og mellemstore virksomheder.

Alexandra Instituttet får ny frontfigur for kunstig intelligens12.1.2026 09:30:00 CET | Pressemeddelelse

Mie Hvas er tiltrådt som Head of AI Lab hos Alexandra Instituttet. Her skal hun omsætte forskning til løsninger, der optimerer processer, analyserer data og giver danske virksomheder et teknologisk forspring.

I vores nyhedsrum kan du læse alle vores pressemeddelelser, tilgå materiale i form af billeder og dokumenter samt finde vores kontaktoplysninger.

Besøg vores nyhedsrum